「社外秘をChatGPTに貼り付けるな!」のその先へ。安全なAI環境構築ガイド

「社外秘をChatGPTに貼り付けるな!」のその先へ。安全なAI環境構築ガイド

「生成AIは情報漏洩リスクがあるため、業務での利用を禁止します」

こんな社内通達、出していませんか?

しかし現場の実態はどうでしょう。

社員は自分のスマホで、こっそりChatGPTを使っています。

禁止してもシャドーIT化するだけ。むしろ管理できない分、リスクは高まります。

本記事では、「禁止」ではなく「安全に使える環境を作る」という発想への転換を提案します。

1. AIで「何が」漏れるのか

まず、リスクを正しく理解しましょう。

無料版AI(個人アカウント)の場合

- 入力した内容がAIの学習データとして利用される可能性がある(設定による)

- 会話履歴が第三者に見られる可能性は低いが、ゼロではない

API / エンタープライズ版の場合

- 学習には使われない(契約上オプトアウト)

- 会話は企業のテナント内に閉じる

- 管理者がログを確認できる

本当のリスクは「何を入力するか」

問題は「AIを使うこと」ではなく、

何を入力してしまうかの管理ができていないことです。

- 顧客名簿をそのまま貼り付ける

- NDAで守られた契約書の条文を要約させる

- プロプライエタリなソースコードをレビューさせる

これらは、どんなに安全なエンタープライズ版を使っていても、

入力した時点で「社外に出した」ことになります。

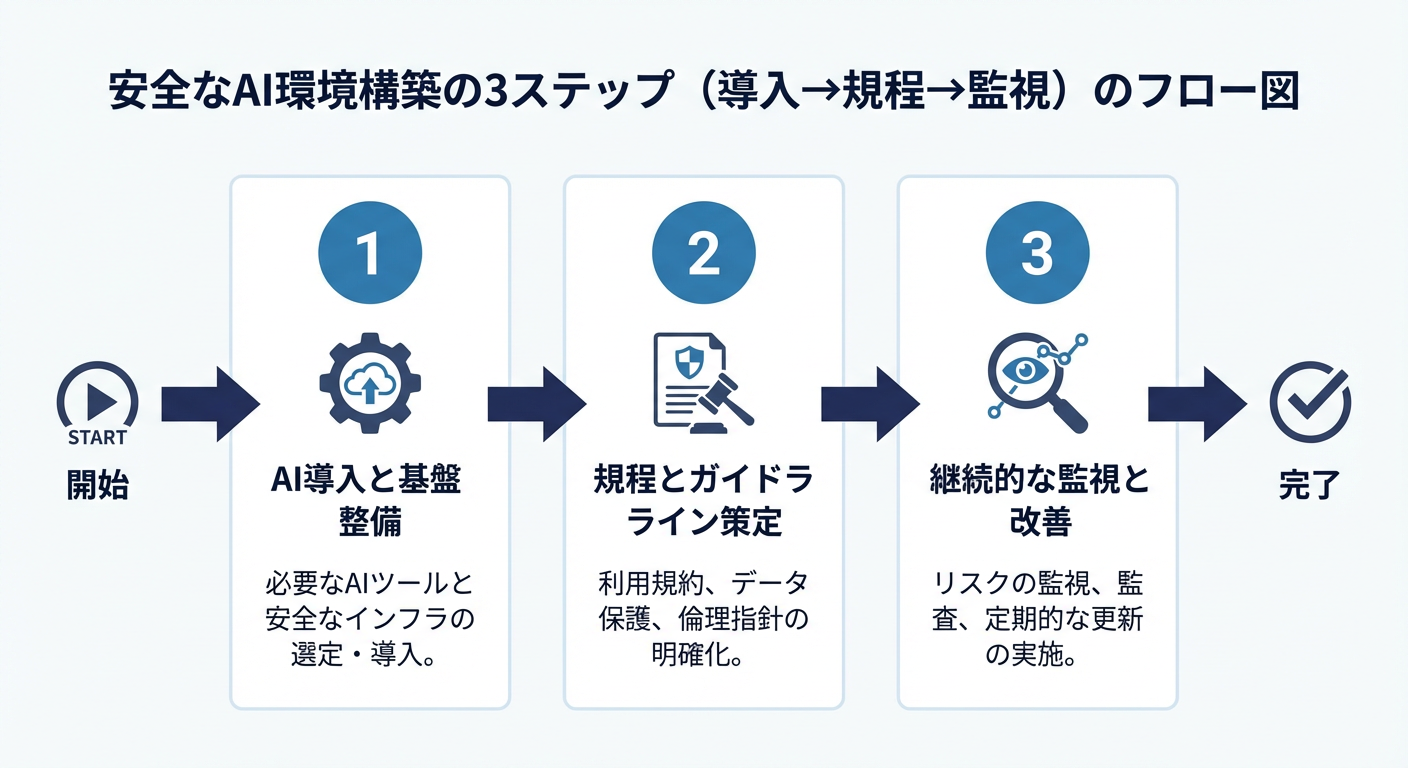

2. 安全なAI利用環境を作る3ステップ

Step 1: エンタープライズ版を導入する

「学習に使われない」「ログが取れる」ツールを選びます。

| ツール | 特徴 |

|---|---|

| ChatGPT Enterprise/Team | データ学習オプトアウト、管理コンソール、SSO |

| Microsoft Copilot for M365 | データはテナント内完結、既存Office連携 |

| Claude for Business | 学習に使用しない契約、Artifacts機能 |

| Google Gemini for Workspace | Googleドライブ連携、Enterprise契約 |

選定基準:

- 入力データが学習に使われない(契約上明記)

- 管理ログが取れる(誰が何を聞いたか)

- 可能ならリージョン指定(日本/アジア)

Step 2: AI利用規程を策定する

「何を入力していいか/ダメか」を明確にするルールを作ります。

| ✅ OK(入力可) | ❌ NG(入力禁止) |

|---|---|

| 公開済み/公開予定の情報 | 個人情報(顧客名、メールアドレス) |

| 一般的なビジネス文書の下書き | 契約書・NDAの内容 |

| 公開記事のレビュー依頼 | 未発表の製品・戦略情報 |

| 自分が書いたメールの添削 | 他社から預かった機密資料 |

入社時に「AI利用に関する同意書」を取るとより安全です。

Step 3: 利用状況をモニタリングする

エンタープライズ版の管理コンソールで、誰が・いつ・何を聞いたかをログ確認できます。

定期的に抜き打ちでチェックし、NG情報が入力されていないか確認します。

ただし、過度な監視は逆効果(萎縮して使わなくなる)。あくまで「ルール違反の抑止力」として。

3. 明日から使える「AI利用規程テンプレート」

社内でそのまま使えるサンプルです。

# AI利用規程(サンプル)

## 第1条(目的)

本規程は、従業員が業務において生成AIを利用する際の、

情報セキュリティおよび個人情報保護のためのルールを定める。

## 第2条(利用可能なツール)

会社が契約した「〇〇(エンタープライズ版AI名)」のみ使用可。

個人アカウントでの無料版AIの業務利用は禁止する。

## 第3条(入力禁止情報)

以下の情報を生成AIに入力してはならない。

1. 個人情報(氏名、連絡先、顧客名簿)

2. 未公開の経営・財務情報

3. 契約書・NDA等の機密文書

4. ソースコード(特にプロプライエタリなもの)

## 第4条(罰則)

本規程に違反した場合、就業規則に基づき懲戒処分の対象となりうる。

4. 「禁止」より「使わせながら守る」

AI禁止令を出している会社と、安全なAI環境を整備した会社。

1年後、どちらが競争力を持っているかは明らかです。

* 禁止する会社: 現場はシャドーIT化。生産性は上がらない。リスクは放置。

* 安全に使わせる会社: 管理下でAI活用。生産性向上。問題発生時も追跡可能。

5. まとめ

* AI禁止はシャドーIT化を招く。リスクは減らない。

* エンタープライズ版 + 利用規程 + モニタリングで「使いながら守る」。

安全にAIが使える環境ができたら、次はAIを「守り」に使いましょう。

次回は、フィッシングメールをAIが自動検知し、社員の誤クリックを未然に防ぐ技術を紹介します。